蚂蚁集团发布LingBot-VLA,一个用于现实世界机器人操作的电影语言行为基础模型。

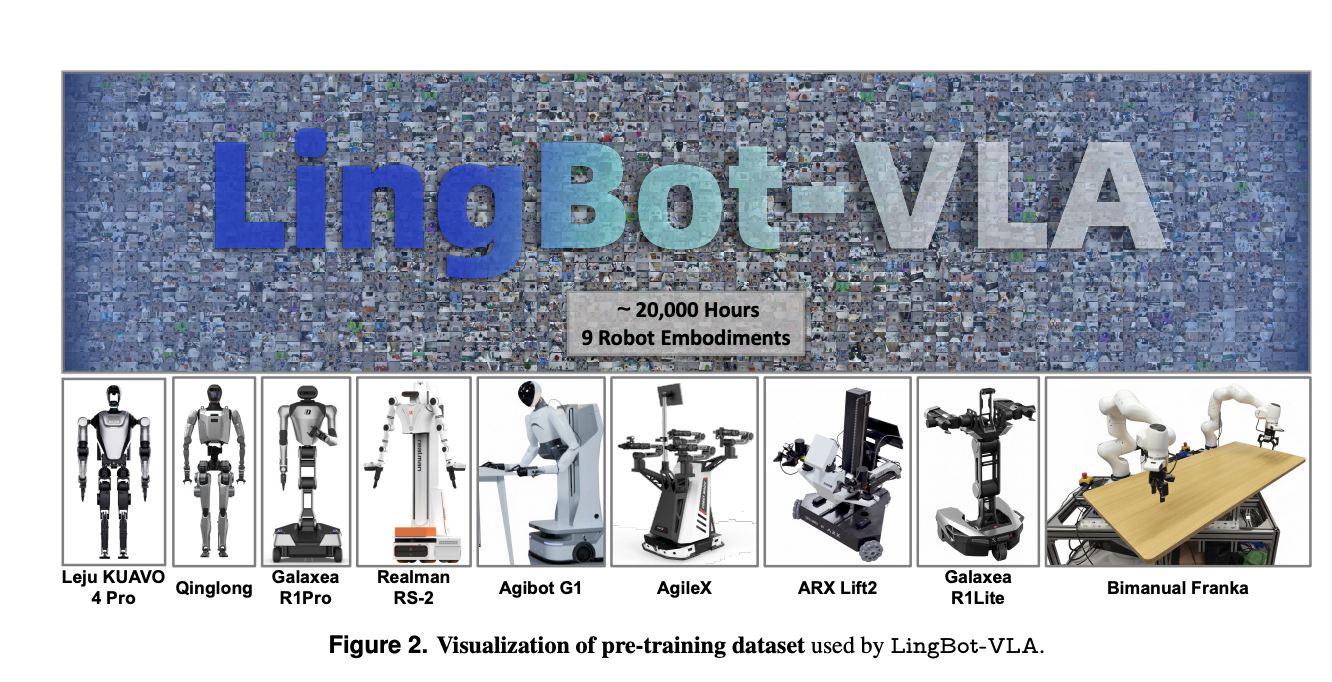

如何构建一个单一视觉语言动作模型,使其能够在现实世界中控制多种不同的双臂机器人?LingBot-VLA是蚂蚁集团Robbyant公司的新视觉语言动作基础模型,旨在用于现实世界的机器人操作。它是在大约20,000小时的远程操控双臂数据集上训练的,这个数据集是从9种双臂机器人实体中收集的,并在大规模GM-100基准测试中的3个平台上进行了评估。该模型旨在实现跨形态泛化、数据高效的后训练和高效训练吞吐量。

https://arxiv.org/pdf/2601.18692

在9个机器人实体上的大规模双臂数据集

预训练数据集是从9种流行的双臂配置的真实世界远程操控中构建的。这些包括AgiBot G1、AgileX、Galaxea R1Lite、Galaxea R1Pro、Realman Rs 02、Leju KUAVO 4 Pro、青龙类人形、ARX Lift2和一个双臂Franka设置。所有系统都配备了双6自由度或7自由度臂部,带有平行夹爪和多个RGB-D摄像头,可以提供多视角观察。

对于AgiBot G1,远程操控使用VR控制,对于AgileX则是同构臂控制。对于每个场景,记录的视频都会由人类注释员分割成与原子操作对应的剪辑。每个剪辑开头和结尾的静态帧被移除以减少冗余。然后使用Qwen3-VL-235B-A22B生成任务级别和子任务级别的语言指令。这个流程产生了用于预训练的图像、指令和动作轨迹的同步序列。

为了表征动作多样性,研究团队通过词云可视化了培训和测试中的最常见原子操作。测试集中有大约50%的原子操作在训练集中前100个最常见动作中未出现。这个差距确保了评估侧重于跨任务泛化,而不是基于频率的记忆。

https://arxiv.org/pdf/2601.18692

架构、Transformer的混合和动作匹配

LingBot-VLA通过混合Transformer架构,将强大的多模态骨干网络与动作专家结合起来。视觉语言骨干是Qwen2.5-VL。它将多视角操作图像和自然语言指令编码成一系列多模态标记。同时,动作专家接收机器人内在状态和先前动作的块。两个分支共享一个自注意力模块,该模块对观察和动作标记执行层次序列建模。

在每个时间步,模型形成了一个观察序列,该序列通过连接来自3个摄像头的标记、任务指令和机器人状态。动作序列是一个时间跨度设置为50的未来动作块。训练目标是条件流动匹配。该模型学习一个矢量场,它沿着线性概率路径将高斯噪声传输到真实动作轨迹。这给出了一种连续的动作表示,并产生了平滑、时间上连续的控制,适用于精确的双臂操纵。

LingBot-VLA在联合序列上使用块状因果注意力。观察标记可以双向注意彼此。动作标记可以注意所有观察标记和仅注意过去动作标记。这个掩码防止了从未来动作中泄露信息到当前观察,同时允许动作专家在每个决策步骤利用完整的多模态上下文。

通过LingBot Depth蒸馏进行空间感知

许多VLA模型在深度传感器失败或返回稀疏测量时难以进行深度推理。LingBot-VLA通过整合基于掩码深度建模的独立空间感知模型LingBot-Depth来解决此问题。LingBot-Depth在大型的RGB-D语料库上以自监督方式进行训练,并学会在深度图的某些部分被掩码时,通常在物理传感器容易失败的区域,重建密集的度量深度。

在LingBot-VLA中,来自每个摄像头的视觉查询通过一个投影层和蒸馏损失与LingBot-Depth标记对齐。跨注意力将VLM查询到深度潜在空间,训练最小化它们与LingBot-Depth特征的差异。这为策略注入了几何感知信息,并提高了在需要精确3D空间推理的任务(如插入、堆叠、折叠)上的性能。

在3个平台上的GM-100现实世界基准测试

主要评估使用了GM-100,这是一个包含100个操作任务和每个任务在3个硬件平台上各有130个过滤远程操作轨迹的现实世界基准测试。实验在共享后训练协议下比较了LingBot-VLA与π0.5、GR00T N1.6和WALL-OSS。所有方法都从相同的公共检查点微调,数据集批大小为256,训练20个周期。成功率衡量在3分钟内完成所有子任务的情况,进度分数跟踪部分完成的情况。

在GM-100上,带有深度信息的LingBot-VLA在3个平台上都实现了最先进的平均成功率和平均进度分数。平均成功率为17.30%,平均进度分数为35.41%。π0.5的成功率(SR)为13.02%,进度分数(PS)为27.65%。GR00T N1.6和WALL-OSS分别较低,成功率为7.59%,进度分数为15.99%,成功率为4.05%,进度分数为10.35%。不带深度的LingBot-VLA已经超越了GR00T N1.6和WALL-OSS,带深度的变体进一步提升了性能。

在RoboTwin 2.0模拟中,共50个任务,在干净场景中为每个任务训练50个演示,在随机化场景中为每个任务训练500个演示。带有深度的LingBot-VLA在干净场景中的平均成功率达到88.56%,在随机化场景中为86.68%。在相同的设置下,π0.5分别达到82.74%和76.76%。这表明,当领域随机化强大时,相同的架构和深度集成可以带来一致的收益。

https://arxiv.org/pdf/2601.18692

扩展行为和数据高效的后训练

研究团队通过将预训练数据从3000小时到20000小时,在25个任务子集上进行了扩展定律分析。成功率和进度分数随着数据量的增加而单调增加,没有达到最大规模的饱和。这是第一项实证研究,表明VLA模型在这个规模上维持了有利的扩展。

他们还研究了在AgiBot G1上使用8个代表性的GM-100任务的后训练的数据效率。仅使用每个任务80个演示,LingBot-VLA已经在成功率(SR)和进度分数(PS)两个方面超过了使用完整的130个演示集的π0.5。随着更多轨迹的增加,性能差距正在扩大。这证实了预训练策略只需要几十到大约100个特定任务的轨迹就可以迁移,这直接降低了新机器人或任务的适应成本。

训练吞吐量和开源工具包

LingBot-VLA带有针对多节点效率优化的训练栈。代码库使用参数和优化器状态FSDP风格策略,动作专家使用混合分片,混合精度(float32减少和bfloat16存储),以及使用融合注意内核和torch compile的运算符级别加速。

在8 GPU环境中,研究团队报告了Qwen2.5-VL-3B和PaliGemma-3B-pt-224模型配置的每GPU每秒261个样本的吞吐量。这比在相同基于Libero基准测试上评估的现有VLA定向代码库,如StarVLA、Dexbotic和OpenPI,快1.5到2.8倍。吞吐量在从8到256 GPU迁移时接近线性扩展。完整的后训练工具包作为开源发布。

关键要点

- LingBot-VLA是一个基于Qwen2.5-VL的视觉语言动作基础模型,在约20,000小时的真实世界双臂远程操控数据上进行了训练,该数据来自9种双臂机器人实体,这使得它在跨形态和跨任务泛化方面表现出色。

- 模型通过特征蒸馏整合LingBot Depth,因此视觉标记与深度完成专家对齐,这显著提高了对插入、堆叠、折叠和其他几何敏感任务的3D空间理解能力。

- 在GM-100现实世界基准测试中,带有深度的LingBot-VLA实现了约17.30%的平均成功率和35.41%的平均进度分数,这比在相同后训练协议下测试的π0.5、GR00T N1.6和WALL-OSS都要高。

- LingBot-VLA在后训练过程中表现出高数据效率,因为在不带深度的AgiBot G1上,它可以使用每个任务大约80个演示胜过使用每个任务130个演示的π0.5,并且随着更多轨迹的增加,性能继续提高。

查看论文、模型权重、Repo和项目页面。也请随意关注我们的Twitter,别忘了加入我们的10万+机器学习SubReddit和订阅我们的时事通讯。等等!你在telegram吗?现在您也可以加入我们的telegram群组。

首先发表在MarkTechPost上的文章Ant Group发布LingBot-VLA,一个针对现实世界机器人操作的可视化语言动作基础模型。